多重共線性の話 ~その5 多重共線性を回避する方法 [データサイエンス、統計モデル]

多重共線性を回避する方法として、いろいろな方法があるが、

ぱっと思いつくのは、lasso回帰とridge回帰かもしれません。

lassoにしろridge回帰にしろ、基本的にはデータドリブンなアプローチなので、仮説発見としては良いかもしれませんが、背景の構造が明確な場合は、想定通りの結果にならない可能性があります。

例えば、lassoは、よくスパースなデータに対しての変数選択として使われます。

ridgeも正則化をしている意味では、数学的には似ています。

多重共線性が起こっている場合、一般に逆行列が計算できない問題が発生するが、正則化を追加することにより,回帰係数が不安定になることを防いでいます。

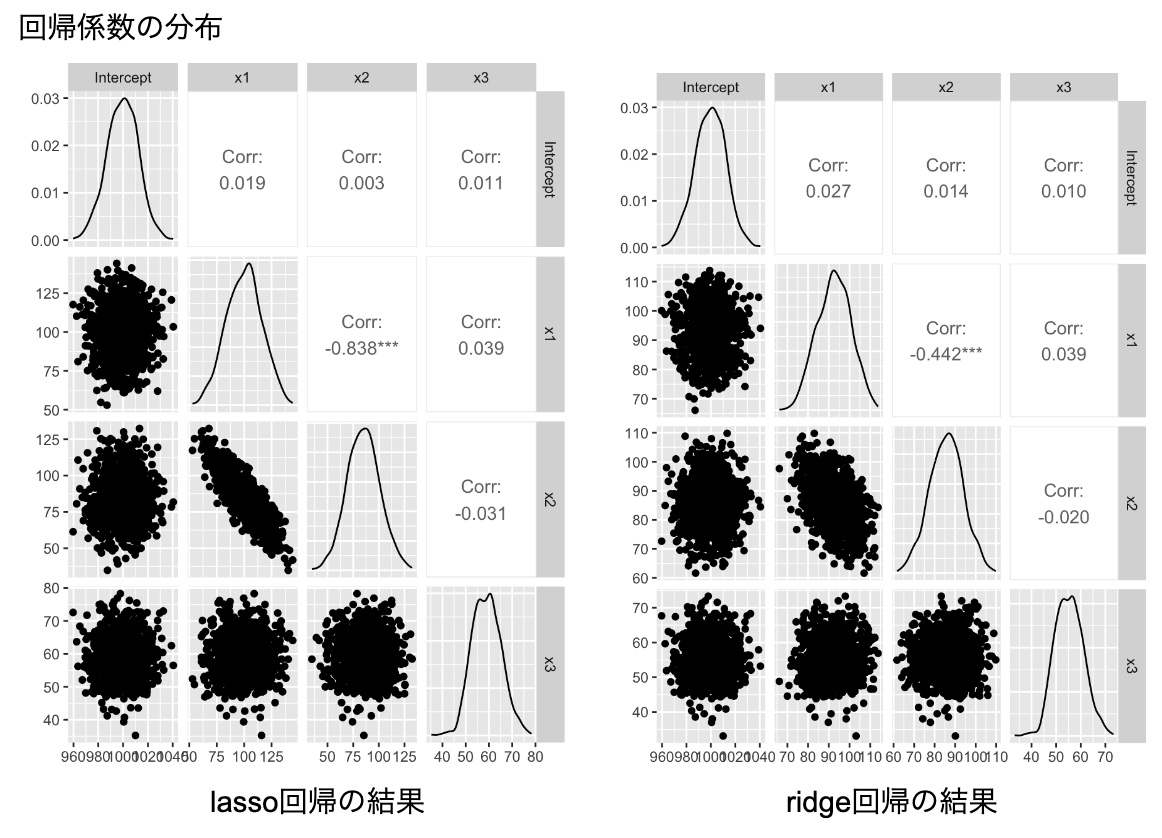

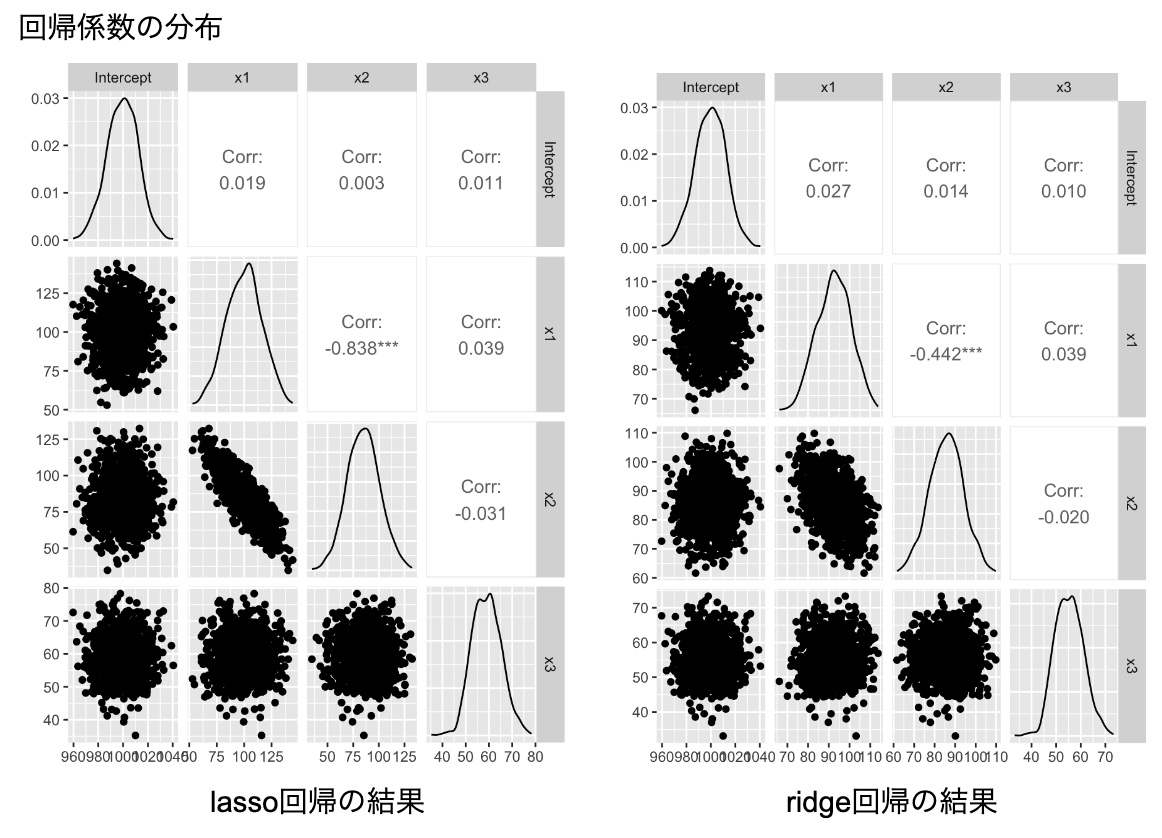

左の図はlassoの結果で、右の図がridge回帰の結果。

lasso回帰の方がridge回帰よりもx1とx2の(負の)相関は強い。

また、真のパラメータを再現できるわけではないですし、特に、ridge回帰の場合は、回帰係数が不安定になることを防ぐために、各回帰係数の値が小さく見積もられていることがわかります。

多重共線性が回避できたという感じはしなく、無難に線形回帰に近い結果が出てきているだけとも言えます。

ぱっと思いつくのは、lasso回帰とridge回帰かもしれません。

lassoにしろridge回帰にしろ、基本的にはデータドリブンなアプローチなので、仮説発見としては良いかもしれませんが、背景の構造が明確な場合は、想定通りの結果にならない可能性があります。

例えば、lassoは、よくスパースなデータに対しての変数選択として使われます。

ridgeも正則化をしている意味では、数学的には似ています。

多重共線性が起こっている場合、一般に逆行列が計算できない問題が発生するが、正則化を追加することにより,回帰係数が不安定になることを防いでいます。

左の図はlassoの結果で、右の図がridge回帰の結果。

lasso回帰の方がridge回帰よりもx1とx2の(負の)相関は強い。

また、真のパラメータを再現できるわけではないですし、特に、ridge回帰の場合は、回帰係数が不安定になることを防ぐために、各回帰係数の値が小さく見積もられていることがわかります。

多重共線性が回避できたという感じはしなく、無難に線形回帰に近い結果が出てきているだけとも言えます。

コメント 0