【SPSS Modeler】ロジスティック回帰とSVMを使った二値分類 その1 [データサイエンス、統計モデル]

買う/買わないといった0,1のデータを分離する方法は色々な方法があります。

その代表的なものといえば、ロジスティック回帰でしょうか。

機械学習的なアプローチでは、決定木やSVM(サポートベクターマシーン)などがあります。

今回は、SPSS Modelerを使って少し変わったやり方で何が起こっているかを理解したいと思います。

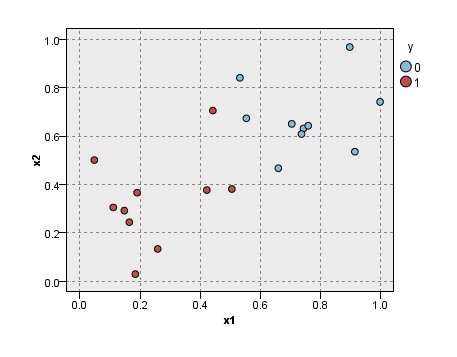

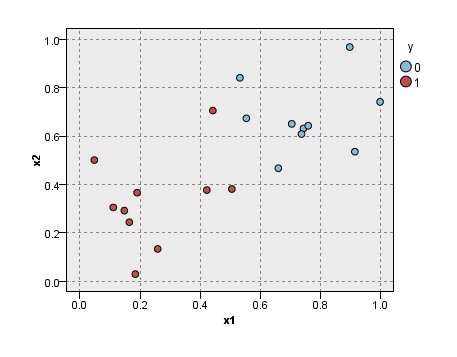

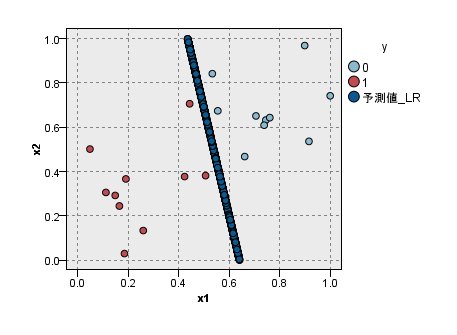

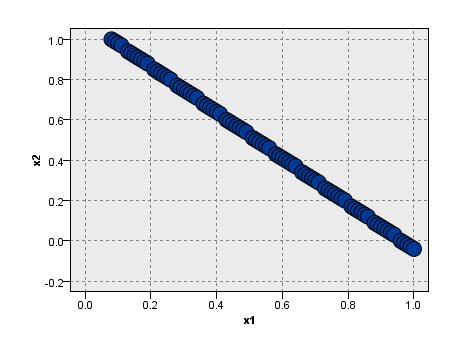

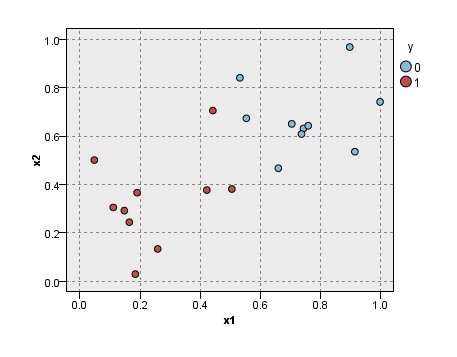

まずは、データの可視化から。

0 <= x1 <= 1

0 <= x2 <= 1

となっています

モデリングを使わなくても、判別は自明なのですが、赤丸と青丸をどのように分離するか考えてみます。

どのように分離になるか(なってほしいか)を考えると、

左上から右下に分離する線分をひきたい!と思うかと思います。

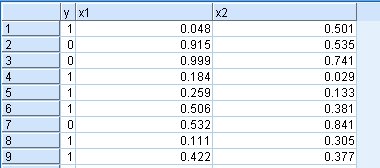

まずは、ロジスティック回帰から。

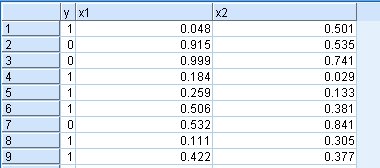

x1, x2を説明変数、yを目的変数に設定し、ロジスティック回帰のモデルを作成します。

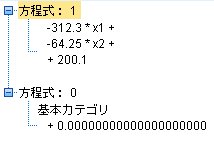

この式から分離する線を引きたいのですが、それは、yの値がちょうど0.5となるx1, x2を求めれば良いわけです。

ロジスティック回帰の場合は、その点を四則演算の組み合わせで計算できますが、SVMでは、簡単に求めることができません。

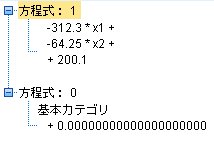

この様な場合は、適当なx1, x2の組み合わせを大量に発生させて、yの値がどうなるかシミュレーションします。

そして、ちょうどyの値が0.5となるx1, x2の組み合わせを持ってくれば、0, 1を分離する線分をひくことができます。

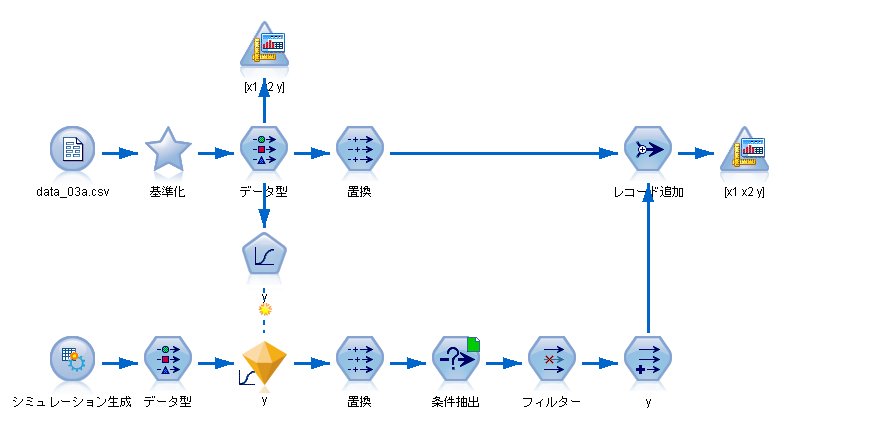

作成したストリームはこんな感じです。

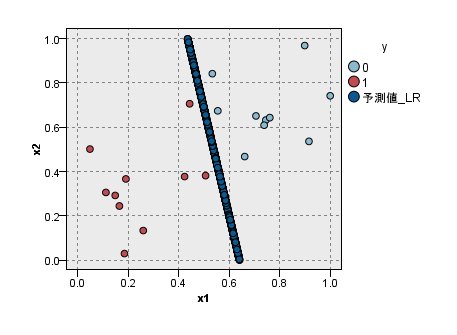

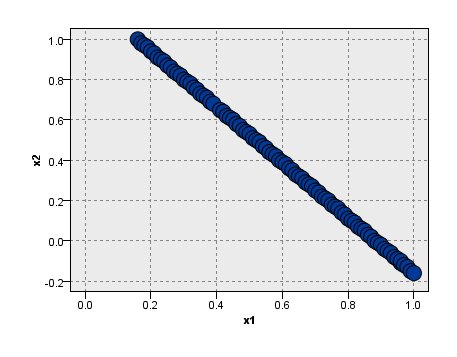

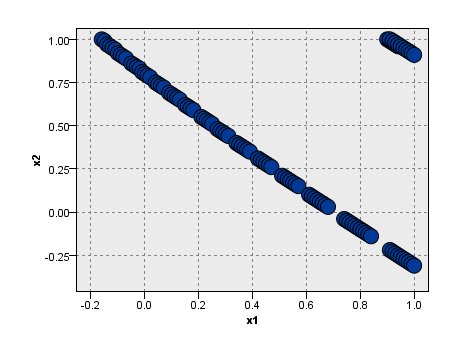

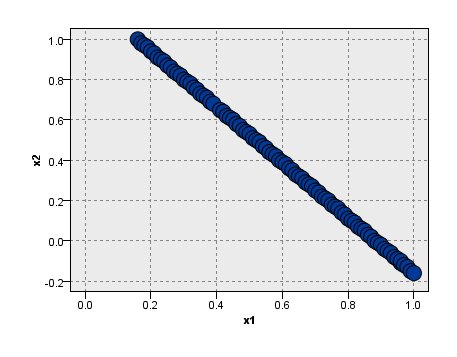

そして、判別結果はこのようになります。

まぁ、仮説通りの納得の結果ですね。

続いて、SVM(サポートベクターマシーン)を使って分離するとどうなるか・・・見てみたいと思います。

※ 今回、作成したストリームが欲しい方は、ご連絡くださいませ。

その代表的なものといえば、ロジスティック回帰でしょうか。

機械学習的なアプローチでは、決定木やSVM(サポートベクターマシーン)などがあります。

今回は、SPSS Modelerを使って少し変わったやり方で何が起こっているかを理解したいと思います。

まずは、データの可視化から。

0 <= x1 <= 1

0 <= x2 <= 1

となっています

モデリングを使わなくても、判別は自明なのですが、赤丸と青丸をどのように分離するか考えてみます。

どのように分離になるか(なってほしいか)を考えると、

左上から右下に分離する線分をひきたい!と思うかと思います。

まずは、ロジスティック回帰から。

x1, x2を説明変数、yを目的変数に設定し、ロジスティック回帰のモデルを作成します。

この式から分離する線を引きたいのですが、それは、yの値がちょうど0.5となるx1, x2を求めれば良いわけです。

ロジスティック回帰の場合は、その点を四則演算の組み合わせで計算できますが、SVMでは、簡単に求めることができません。

この様な場合は、適当なx1, x2の組み合わせを大量に発生させて、yの値がどうなるかシミュレーションします。

そして、ちょうどyの値が0.5となるx1, x2の組み合わせを持ってくれば、0, 1を分離する線分をひくことができます。

作成したストリームはこんな感じです。

そして、判別結果はこのようになります。

まぁ、仮説通りの納得の結果ですね。

続いて、SVM(サポートベクターマシーン)を使って分離するとどうなるか・・・見てみたいと思います。

※ 今回、作成したストリームが欲しい方は、ご連絡くださいませ。

【SPSS Modeler】ロジスティック回帰とSVMを使った二値分類 その2 [データサイエンス、統計モデル]

【SPSS Modeler】ロジスティック回帰とSVMを使った二値分類 その1

http://skellington.blog.so-net.ne.jp/2018-03-01

↑

前回は、ロジスティック回帰を使いましたが、今回は、SVM(サポートベクターマシーン)を使い二値分類を行います。

データは、前回と同様に、こちらのデータを使います。

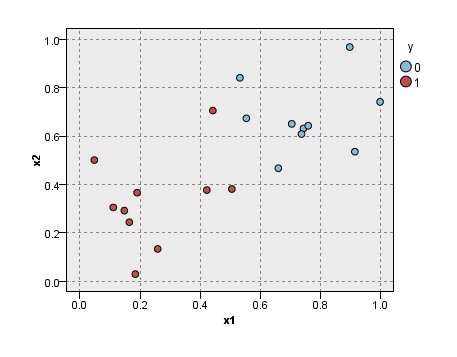

SVM(サポートベクターマシーン)は、線形SVMと非線形SVMがあります。

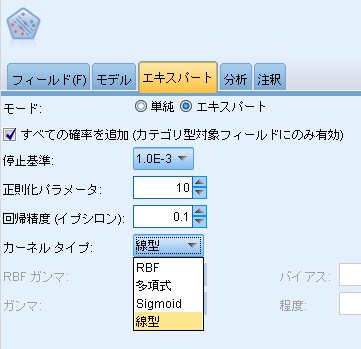

SPSS Modelerでも、エキスパート設定をすえば、線形SVM(線形)と非線形SVM(RBF, 多項式, Sigmoid)が用意されています。

今回のデータでは、明らかに線形SVMで良いのですが、あえて非線形SMVも使ってみることにします。

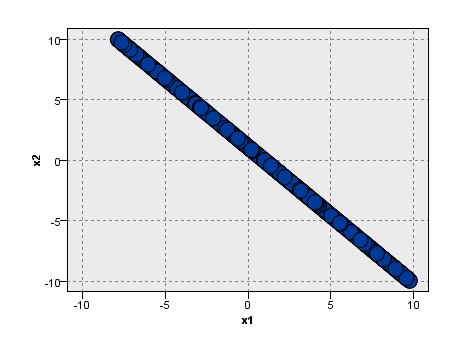

まずは、線形SMVから。

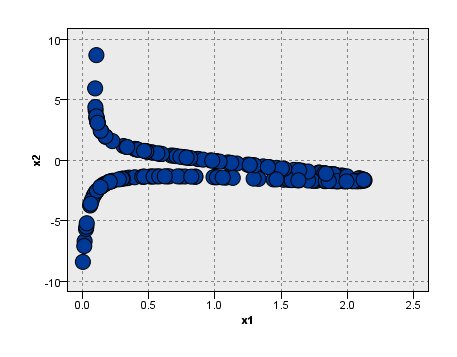

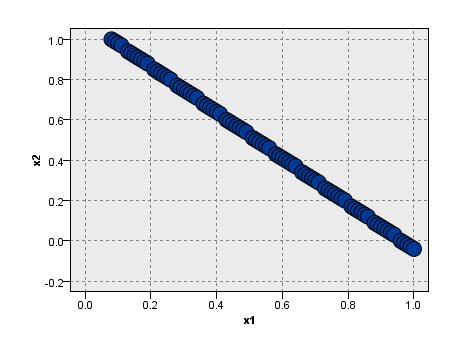

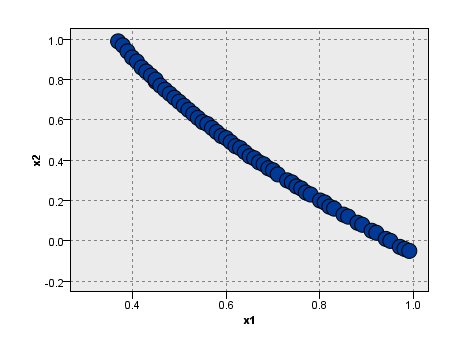

モデルを作成して、シミュレーションを使い、線形分離する直線をひきます。

直線SVMなので、直線ですね。

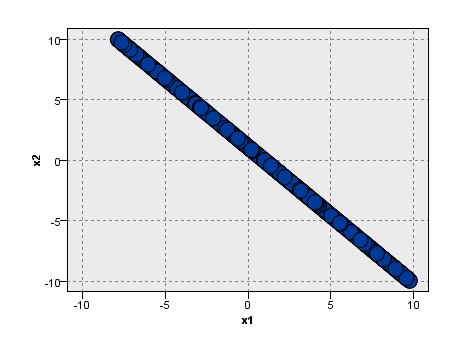

念のためにx1, x2の範囲を10倍くらい大きくしても直線のままです。

↑

この様に書くと、非線形SVMは違うのか!?というネタバレになってしまいますが・・・

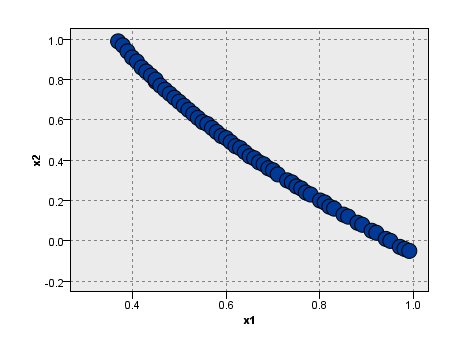

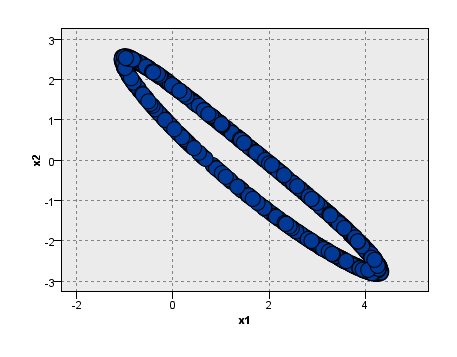

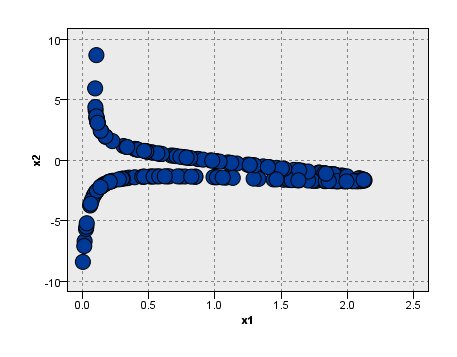

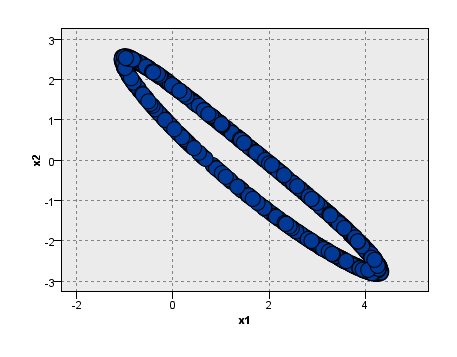

続いて、非線形SMV。

非線形SMVは、線形分離できないデータに対して、カーネルトリックを使うことで、超平面にデータを写像してから、線形SVMと同じ仕組みでデータを分離します。

線形SVMと同様に3種類の非線形SVM(RBF, 多項式, Sigmoid)を試していきます。

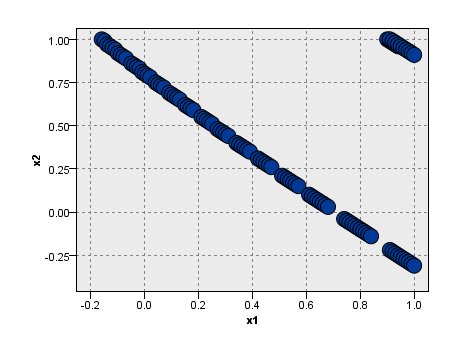

RBFの結果 → おおむね線形

多項式の結果 → やや非線形

Sigmoidの結果 → おおむね線形

だいたい、線形SVMと同じような結果に見えますが、

Sigmoidだけ少し変な線分が見えますよね。

これは何でしょうか?

「バグ? or 異常値?」と思って、目をつぶってしまうとダメで、実務においても、このようなグラフを見て違和感を感じれるか感じられないかが、分析者にとって大切な心構えだと思っています。

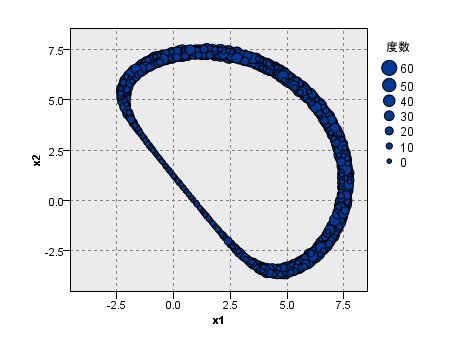

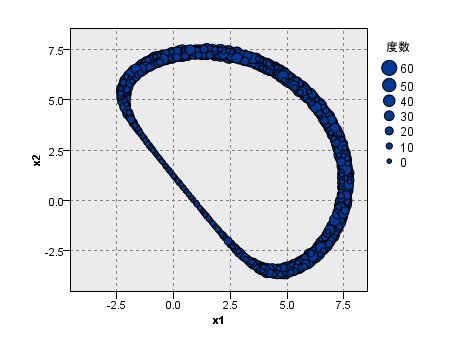

そこで、x1, x2の範囲を大きくしてシミュレーションしてみます。

RBFの結果

多項式の結果

Sigmoidの結果

RBFや多項式は、まさしくそれっぽい感じで分離されていました。

今回は、x1, x2の2変数のみでモデルを作成しましたが、最近の流れとしては、膨大な数の特徴量を作成し、モデリングをしている事例を見かけます。

しかも、精度が劣化するという理由で、定期的に自動でモデリングを行う機能をもったソフトウェアも多数出てきました。

近年、機械学習の敷居は下がってきており、ツールが使える人の数は年々増えてきています。

しかし、アルゴリズムの癖をきちんと理解した上で、正しい使い方ができている人はほとんど増えていない印象です。

今回のようなシンプルな事例では、発見できる異常な現象も、膨大な変数やレコードに埋もれてしまい、発見できない場合が多数あります。

もちろん機械学習が得意とする分野もあるので、今回解き明かしたい課題に対してはどのアプローチが適切なのかを考えた上で便利なツールを使っていくことが重要だと思います。

http://skellington.blog.so-net.ne.jp/2018-03-01

↑

前回は、ロジスティック回帰を使いましたが、今回は、SVM(サポートベクターマシーン)を使い二値分類を行います。

データは、前回と同様に、こちらのデータを使います。

SVM(サポートベクターマシーン)は、線形SVMと非線形SVMがあります。

SPSS Modelerでも、エキスパート設定をすえば、線形SVM(線形)と非線形SVM(RBF, 多項式, Sigmoid)が用意されています。

今回のデータでは、明らかに線形SVMで良いのですが、あえて非線形SMVも使ってみることにします。

まずは、線形SMVから。

モデルを作成して、シミュレーションを使い、線形分離する直線をひきます。

直線SVMなので、直線ですね。

念のためにx1, x2の範囲を10倍くらい大きくしても直線のままです。

↑

この様に書くと、非線形SVMは違うのか!?というネタバレになってしまいますが・・・

続いて、非線形SMV。

非線形SMVは、線形分離できないデータに対して、カーネルトリックを使うことで、超平面にデータを写像してから、線形SVMと同じ仕組みでデータを分離します。

線形SVMと同様に3種類の非線形SVM(RBF, 多項式, Sigmoid)を試していきます。

RBFの結果 → おおむね線形

多項式の結果 → やや非線形

Sigmoidの結果 → おおむね線形

だいたい、線形SVMと同じような結果に見えますが、

Sigmoidだけ少し変な線分が見えますよね。

これは何でしょうか?

「バグ? or 異常値?」と思って、目をつぶってしまうとダメで、実務においても、このようなグラフを見て違和感を感じれるか感じられないかが、分析者にとって大切な心構えだと思っています。

そこで、x1, x2の範囲を大きくしてシミュレーションしてみます。

RBFの結果

多項式の結果

Sigmoidの結果

RBFや多項式は、まさしくそれっぽい感じで分離されていました。

今回は、x1, x2の2変数のみでモデルを作成しましたが、最近の流れとしては、膨大な数の特徴量を作成し、モデリングをしている事例を見かけます。

しかも、精度が劣化するという理由で、定期的に自動でモデリングを行う機能をもったソフトウェアも多数出てきました。

近年、機械学習の敷居は下がってきており、ツールが使える人の数は年々増えてきています。

しかし、アルゴリズムの癖をきちんと理解した上で、正しい使い方ができている人はほとんど増えていない印象です。

今回のようなシンプルな事例では、発見できる異常な現象も、膨大な変数やレコードに埋もれてしまい、発見できない場合が多数あります。

もちろん機械学習が得意とする分野もあるので、今回解き明かしたい課題に対してはどのアプローチが適切なのかを考えた上で便利なツールを使っていくことが重要だと思います。

映画『「ドラえもん のび太の宝島』 ~見つけたのは、宝物以上の、宝物 [テレビ / 映画]

今日から映画の公開ですが、さっそく映画を観てきました。

毎年、この時期は、息子も娘もドラえもんの映画を楽しみにしています。

今年の映画も、とても良い内容でした。

キャッチコピーとして、「見つけたのは、宝物以上の、宝物」。

映画の中で、具体的にそれは言及していないので、映画を観た人それぞれで、その宝物が何か違ってくるかと思います。

息子に聞いたら、自分の答えと少し違っていて、なるほど、そういう見方もあるんだね~、と感心しました。

ちなみに、エンドロールが始まってすぐに立つ人が多いのですが、ドラえもんの映画はエンドロールの後に、必ず少しの映画の続きが流れるのと、来年度の予告も流れます。

できれば、最後まで観て行って欲しいものです。。。

毎年、この時期は、息子も娘もドラえもんの映画を楽しみにしています。

今年の映画も、とても良い内容でした。

キャッチコピーとして、「見つけたのは、宝物以上の、宝物」。

映画の中で、具体的にそれは言及していないので、映画を観た人それぞれで、その宝物が何か違ってくるかと思います。

息子に聞いたら、自分の答えと少し違っていて、なるほど、そういう見方もあるんだね~、と感心しました。

ちなみに、エンドロールが始まってすぐに立つ人が多いのですが、ドラえもんの映画はエンドロールの後に、必ず少しの映画の続きが流れるのと、来年度の予告も流れます。

できれば、最後まで観て行って欲しいものです。。。

天然温泉施設「船橋温泉 湯楽の里」 [温泉・スーパー銭湯]

久々に、南船橋のららぽーとに行ってきました。

その後に、行ったのが、「船橋温泉 湯楽の里」。

千葉県船橋市の天然温泉施設「船橋温泉 湯楽の里」

https://www.yurakirari.com/yura/funabashi/

こちらの温泉も久しぶりです。

車で行くと、いつも渋滞しているのですが、今回も相当渋滞していました。

ただ、それでも人気の温泉みたいで、中は混雑。

お食事処も混雑していました。

お風呂の種類が多いのと、ロウリュウサウナの時間が多いってのが人気なんでしょうかね。

その後に、行ったのが、「船橋温泉 湯楽の里」。

千葉県船橋市の天然温泉施設「船橋温泉 湯楽の里」

https://www.yurakirari.com/yura/funabashi/

こちらの温泉も久しぶりです。

車で行くと、いつも渋滞しているのですが、今回も相当渋滞していました。

ただ、それでも人気の温泉みたいで、中は混雑。

お食事処も混雑していました。

お風呂の種類が多いのと、ロウリュウサウナの時間が多いってのが人気なんでしょうかね。

【モンスト】ヤマトタケル【運極達成】 [ゲーム]

今さらながら、ヤマタケの運極を達成しました。

【超絶】の運極としては、イザナミ、クシナダに続けて3体目となります。

イザナミ、クシナダに比べてドロップ率が低いのと、事故する場合が多く、途中で運極を目指すのを、放置していました。。。w

ふとした時に、ヤマタケをやってみたら、意外と安定するパーティー構成だったので、それから再び運極を目指していました。

ちなみに、こんなパーティーです。

1枠目:メルエム(進化)

2枠目:蒲公英(獣神化)

3枠目:ベルゼブブ(獣神化)

4枠目:パンドラ(進化)

でした。

メルエムに変えて、クシナダ(進化)やスノーマン(神化)入れましたが、ぱっとせず・・・

蒲公英(獣神化)x2とか、ベルゼブブ(獣神化)x2とかでも、しっくりこず・・・

なんだかんだと、色々なタイプの種類の方が事故が少ないかなという印象でした。

※ 運極達成の画像ですが、ヤマタケの運極を目指す途中で、ヤマタケ廻をクリアできたので、ヤマタケ廻の運極となっています。

【超絶】の運極としては、イザナミ、クシナダに続けて3体目となります。

イザナミ、クシナダに比べてドロップ率が低いのと、事故する場合が多く、途中で運極を目指すのを、放置していました。。。w

ふとした時に、ヤマタケをやってみたら、意外と安定するパーティー構成だったので、それから再び運極を目指していました。

ちなみに、こんなパーティーです。

1枠目:メルエム(進化)

2枠目:蒲公英(獣神化)

3枠目:ベルゼブブ(獣神化)

4枠目:パンドラ(進化)

でした。

メルエムに変えて、クシナダ(進化)やスノーマン(神化)入れましたが、ぱっとせず・・・

蒲公英(獣神化)x2とか、ベルゼブブ(獣神化)x2とかでも、しっくりこず・・・

なんだかんだと、色々なタイプの種類の方が事故が少ないかなという印象でした。

※ 運極達成の画像ですが、ヤマタケの運極を目指す途中で、ヤマタケ廻をクリアできたので、ヤマタケ廻の運極となっています。

MASTER'S DREAM HOUSE [グルメ / クッキング]

MASTER'S DREAM HOUSE

https://www.hotpepper.jp/strJ000763211/

↑

こちらで飲み会がありました。

13品!とありましたが、最初に出てくる前菜の一つ一つが1品にカウントされ、前菜だけで6, 7種類分くらいカウント数でした。。。

その部分は期待外れでしたが、最初の一杯だけ提供されるビールは美味しかったです。

ビール一杯と軽い食事としての利用ならありかもしれません。

https://www.hotpepper.jp/strJ000763211/

↑

こちらで飲み会がありました。

13品!とありましたが、最初に出てくる前菜の一つ一つが1品にカウントされ、前菜だけで6, 7種類分くらいカウント数でした。。。

その部分は期待外れでしたが、最初の一杯だけ提供されるビールは美味しかったです。

ビール一杯と軽い食事としての利用ならありかもしれません。

SONYのNeural Network Console、チュートリアルを動かす [データサイエンス、統計モデル]

~ セットアップ方法 ~

・Setupをクリックして、【ENGINE】タブに移動します。

・CPU、GPUを選択できます。

~ チュートリアル(使い方) ~

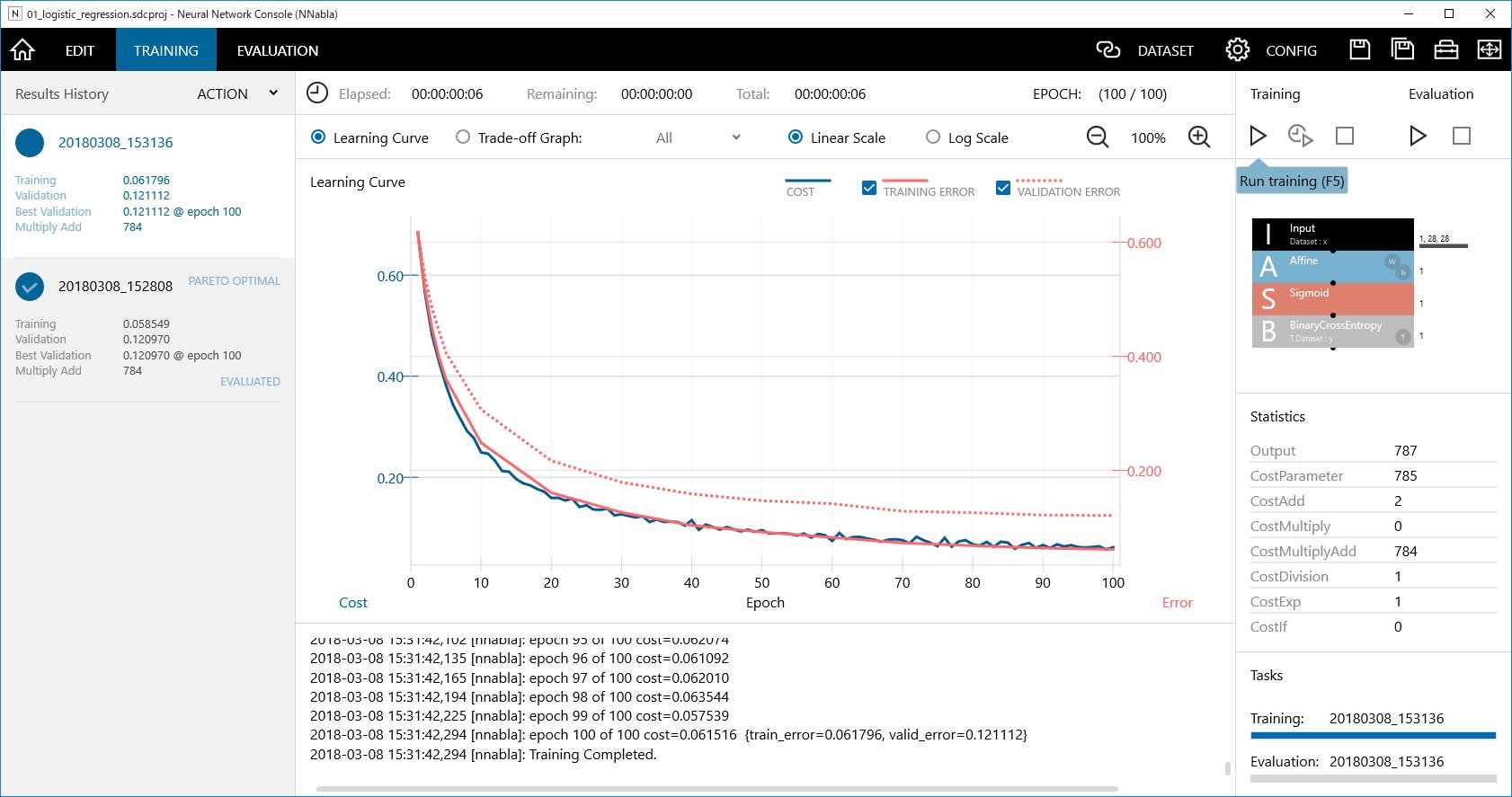

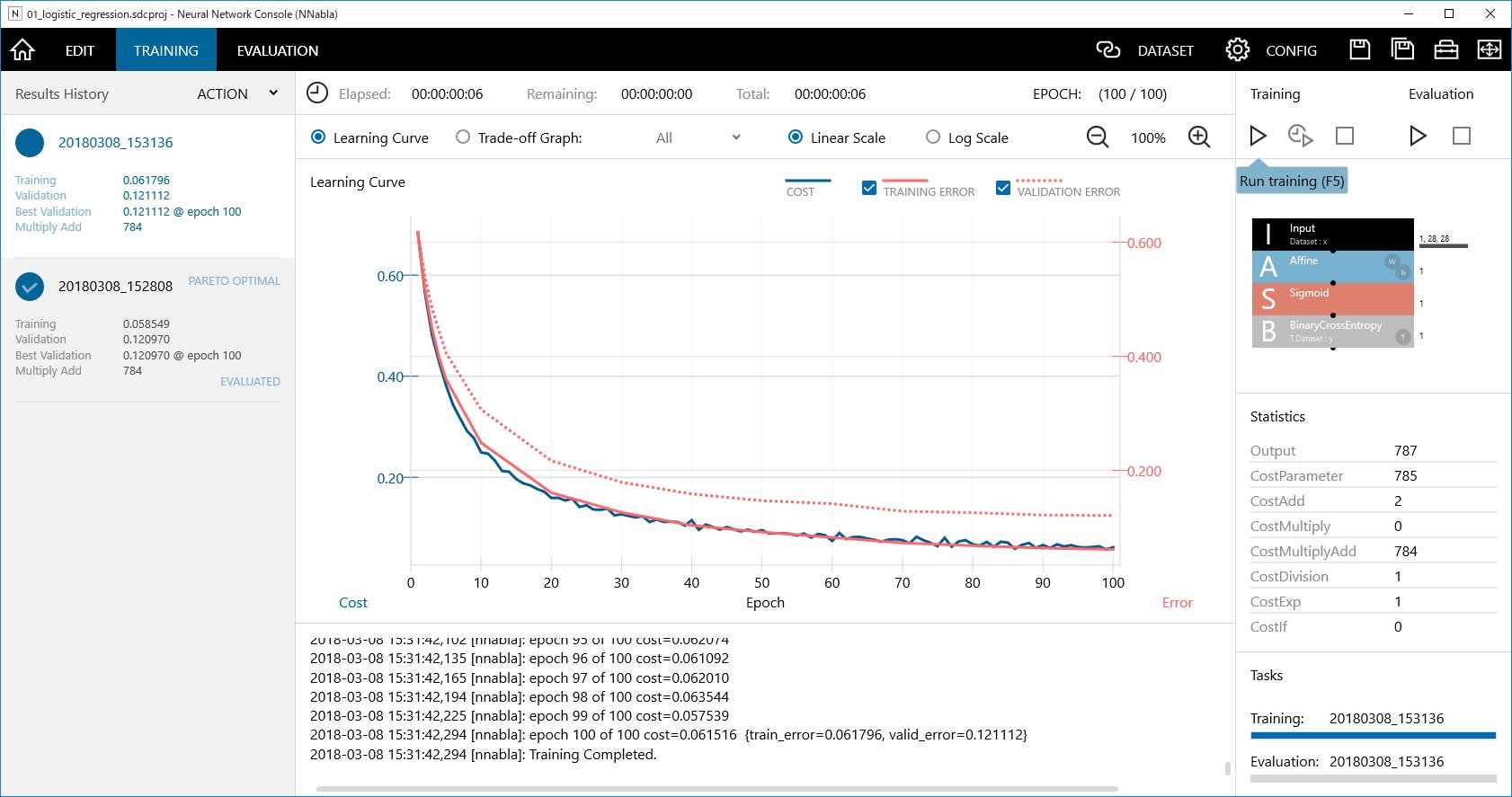

セットアップが終わって、プロジェクト一覧から【01_logistic_regression.sdcproj】を選択します。

MNISTのデータをダウンロードする必要があるみたいなので、データセットのダウンロード。

DATASETをクリックすると、サンプルデータを見ることができます。

~ TRAINING 方法 ~

TRAININGタブをクリックして、【Run training(F5)】をクリックします。

すると、自動でモデルが動き出します。

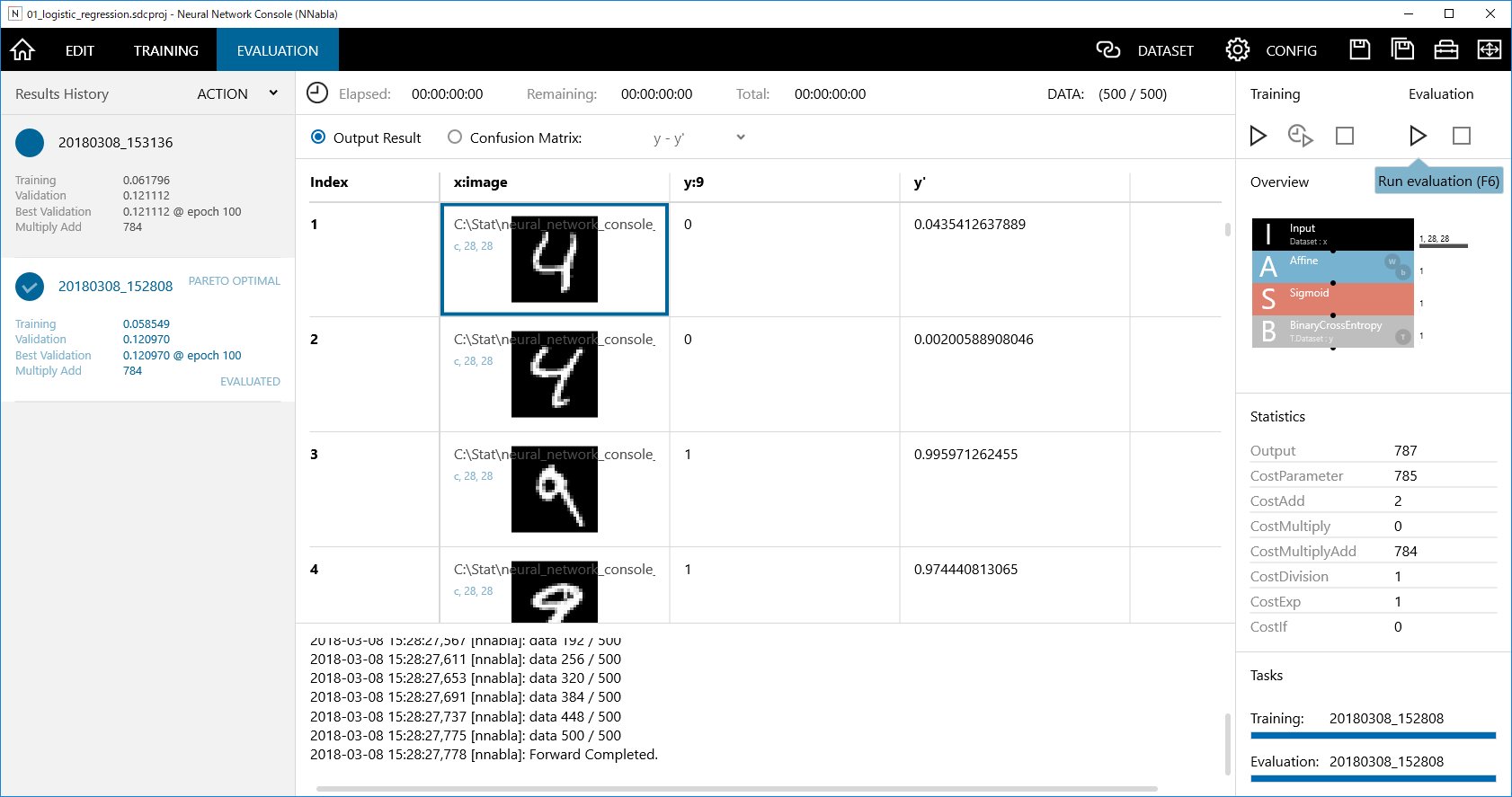

~ EVALUATION 方法 ~

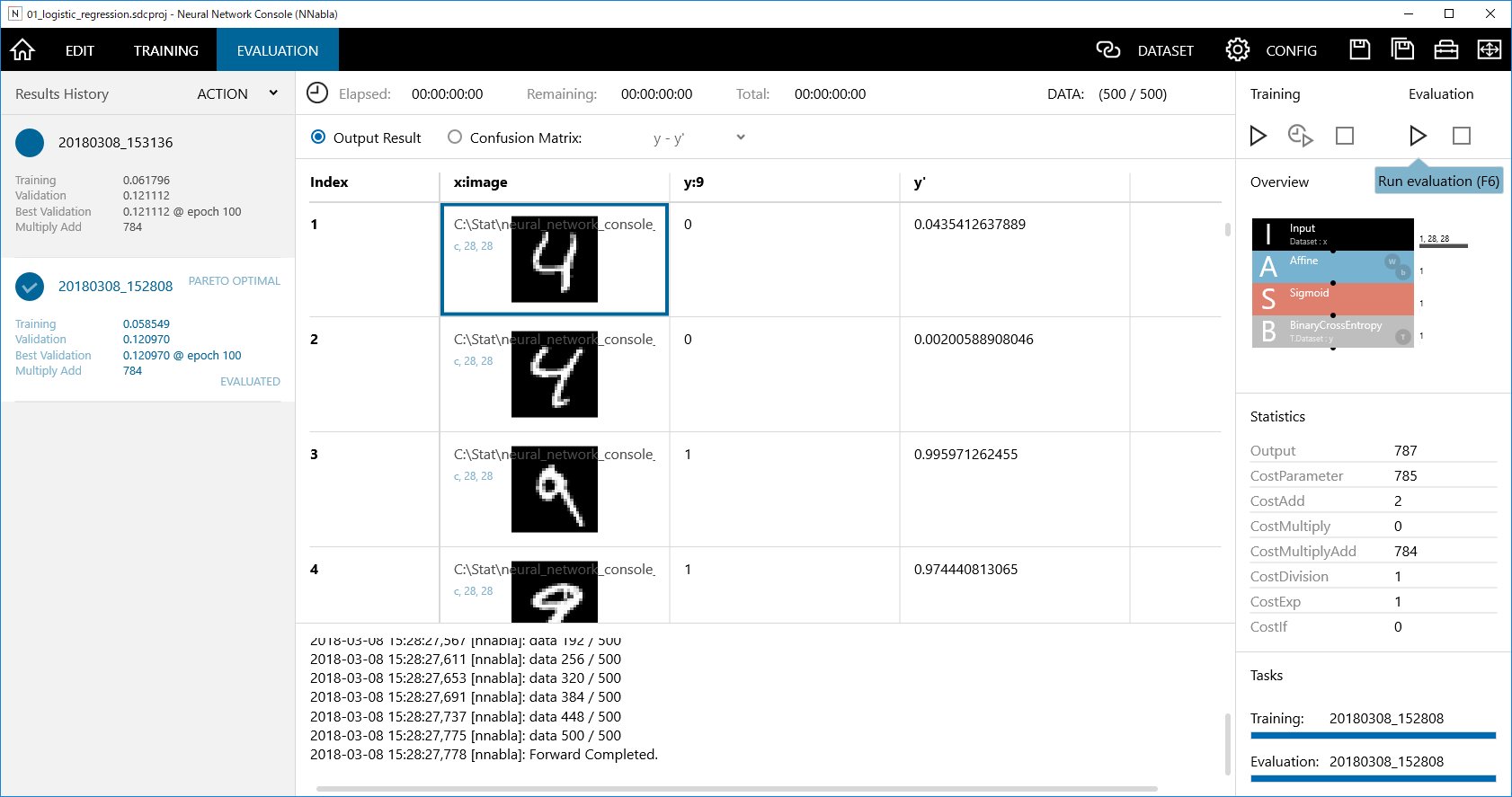

続いて、モデルの評価ですが、EVALUATIONタブをクリックして、【Run evaluation(F6)】をクリックします。

こちらも一瞬で答えがでます。

4に近い予測だと0に近く、9に近い予測だと1に近くなります。

ただ、人間が見ても、4なのか9なのか、あるいは、別の数字に見えるようなあいまいな文字に関しては、出てきたスコアも微妙な値になっていました。

・Setupをクリックして、【ENGINE】タブに移動します。

・CPU、GPUを選択できます。

~ チュートリアル(使い方) ~

セットアップが終わって、プロジェクト一覧から【01_logistic_regression.sdcproj】を選択します。

MNISTのデータをダウンロードする必要があるみたいなので、データセットのダウンロード。

DATASETをクリックすると、サンプルデータを見ることができます。

~ TRAINING 方法 ~

TRAININGタブをクリックして、【Run training(F5)】をクリックします。

すると、自動でモデルが動き出します。

~ EVALUATION 方法 ~

続いて、モデルの評価ですが、EVALUATIONタブをクリックして、【Run evaluation(F6)】をクリックします。

こちらも一瞬で答えがでます。

4に近い予測だと0に近く、9に近い予測だと1に近くなります。

ただ、人間が見ても、4なのか9なのか、あるいは、別の数字に見えるようなあいまいな文字に関しては、出てきたスコアも微妙な値になっていました。

高校で統計学が必須化 [時事 / ニュース]

2022年度から、高校で統計必須化が決まった。

統計が必須になるということは、逆になくなる部分があり、逆に、ベクトルが必須ではなくなっている。

「高校数学での統計学必修化は間違っている」という記事を読んだが、個人的には、

「高校数学での統計学必修化は間違っている」というのが、間違っている。

と思う。

> 数学は「演繹的」、統計学は「帰納的」

まぁ、わからなくもないけど、統計も理論の導出は「演繹的」に行われているし、

「演繹的」だから、「帰納的」だから、ということを持ち出していることに違和感を感じる。

世界的にみれば、統計学部がある国はたくさんある。

日本には、存在しません。。。

海外では、統計的なツールである、フィッシュボーンを小学校の授業でする国もあるし、

回帰分析も中学生くらいで教えている国も普通に存在します。

今の世の中が、それだけ統計を必要としているからであり、むしろ、大学にならないと本格的にそれを勉強する機会がないのは、世界の流れから逆行しているように思えます。

それに、マスコミなどがたまに見せる恣意的なグラフや数字のウソに騙されないためにも。w

統計が必須になるということは、逆になくなる部分があり、逆に、ベクトルが必須ではなくなっている。

「高校数学での統計学必修化は間違っている」という記事を読んだが、個人的には、

「高校数学での統計学必修化は間違っている」というのが、間違っている。

と思う。

> 数学は「演繹的」、統計学は「帰納的」

まぁ、わからなくもないけど、統計も理論の導出は「演繹的」に行われているし、

「演繹的」だから、「帰納的」だから、ということを持ち出していることに違和感を感じる。

世界的にみれば、統計学部がある国はたくさんある。

日本には、存在しません。。。

海外では、統計的なツールである、フィッシュボーンを小学校の授業でする国もあるし、

回帰分析も中学生くらいで教えている国も普通に存在します。

今の世の中が、それだけ統計を必要としているからであり、むしろ、大学にならないと本格的にそれを勉強する機会がないのは、世界の流れから逆行しているように思えます。

それに、マスコミなどがたまに見せる恣意的なグラフや数字のウソに騙されないためにも。w

SONYのNeural Network Console、リンゴとトマトを分類させる [データサイエンス、統計モデル]

SONYのNeural Network Console、チュートリアルを動かす

http://skellington.blog.so-net.ne.jp/2018-03-07

↑

前回の続きです。

チュートリアルではなく、自分で用意した画像で分類させてみました。

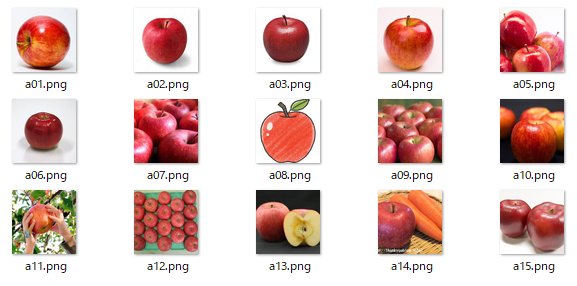

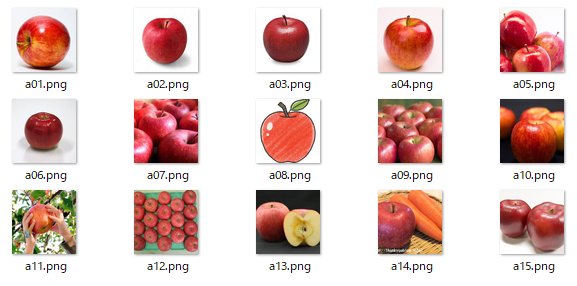

まずは、リンゴの画像から。

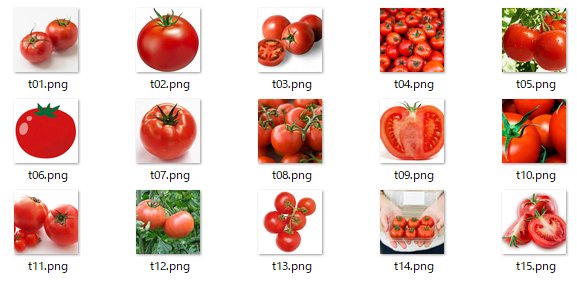

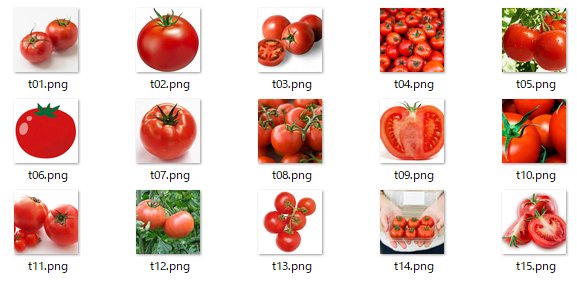

続いて、トマトの画像です。

正面から見た画像、切った画像、ニンジンと一緒に写っている画像、絵で描かれた画像などなどを用意しました。

学習に使ったデータは、リンゴ10枚、トマト10枚です。

予測に使ったデータは、リンゴ5枚、トマト5枚です。

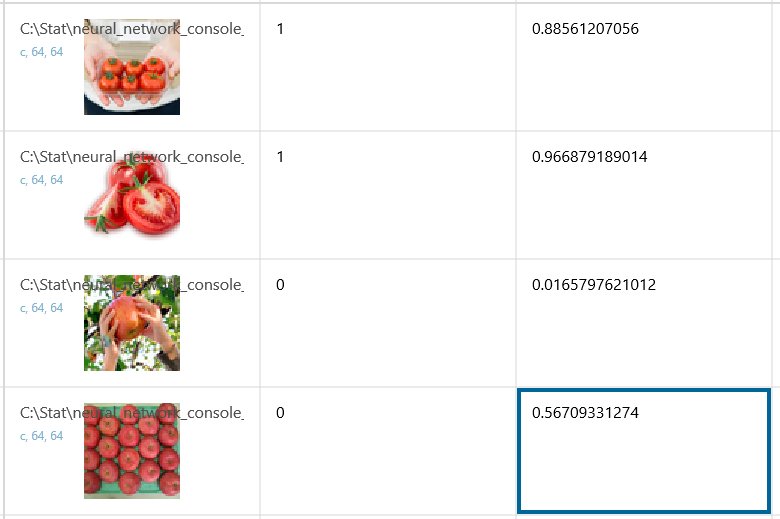

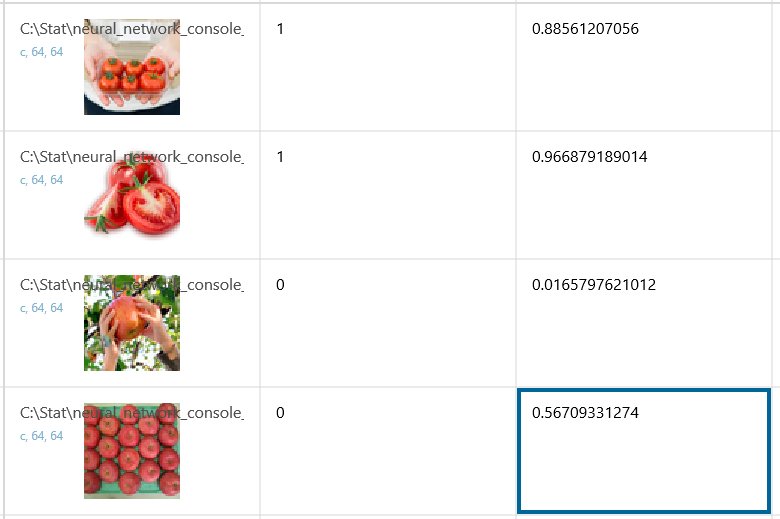

学習したモデルに対して、予測スコアを当てはめてみると、意外と良い精度でした。

普通の画像だと、はっきりとトマトかリンゴか分類することができます。

自分が間違うかなと思い用意した画像があります。

・リンゴをつかんでいる画像

緑の葉っぱが写っているので、トマトと間違うのでは?

→ 結果は、しっかりとリンゴと区別していました。

・真上から見た画像

→ こちらのスコアは、0.567となっており、トマトともリンゴとも曖昧な結果になっていました。

人間が見ても、ちょっとわかりにくい画像でしたね。。。

ということで、SONYのNeural Network Consoleを使って遊んでみましたが、意外と使えそうな気がしました。

http://skellington.blog.so-net.ne.jp/2018-03-07

↑

前回の続きです。

チュートリアルではなく、自分で用意した画像で分類させてみました。

まずは、リンゴの画像から。

続いて、トマトの画像です。

正面から見た画像、切った画像、ニンジンと一緒に写っている画像、絵で描かれた画像などなどを用意しました。

学習に使ったデータは、リンゴ10枚、トマト10枚です。

予測に使ったデータは、リンゴ5枚、トマト5枚です。

学習したモデルに対して、予測スコアを当てはめてみると、意外と良い精度でした。

普通の画像だと、はっきりとトマトかリンゴか分類することができます。

自分が間違うかなと思い用意した画像があります。

・リンゴをつかんでいる画像

緑の葉っぱが写っているので、トマトと間違うのでは?

→ 結果は、しっかりとリンゴと区別していました。

・真上から見た画像

→ こちらのスコアは、0.567となっており、トマトともリンゴとも曖昧な結果になっていました。

人間が見ても、ちょっとわかりにくい画像でしたね。。。

ということで、SONYのNeural Network Consoleを使って遊んでみましたが、意外と使えそうな気がしました。

【モンスト】闇ドラえもん【運極達成】 [ゲーム]

ドラえもんコラボ2018で第四弾になるらしい。

今回は、シルバーを倒すことで、闇ドラを入手することが可能です。

パーティー構成はこんな感じでした。

1枠目:エレシュキガル(進化)

2枠目:エレシュキガル(進化)

3枠目:パンドラ(神化)

4枠目:パンドラ(神化) or 蒲公英(獣神化)

基本は、パンドラを引っ張るだけの簡単なクエストです。

今回は、シルバーを倒すことで、闇ドラを入手することが可能です。

パーティー構成はこんな感じでした。

1枠目:エレシュキガル(進化)

2枠目:エレシュキガル(進化)

3枠目:パンドラ(神化)

4枠目:パンドラ(神化) or 蒲公英(獣神化)

基本は、パンドラを引っ張るだけの簡単なクエストです。

【モンスト】しずか【運極達成】 [ゲーム]

出てくるミッションをクリアしていけば、自然と運極になります。

今回は、全部、クリアしましたが、フレンドガチャとかログインボーナスで、余剰のしずかちゃんを入手できるので、全部クリアする必要はないようです。

今回は、全部、クリアしましたが、フレンドガチャとかログインボーナスで、余剰のしずかちゃんを入手できるので、全部クリアする必要はないようです。

【モンスト】ツクヨミ【運極達成】 [ゲーム]

超絶キャラの中でも、おすすめ運極ランキング上位に入っているのがツクヨミ。

一筆書きに慣れると、それほど難しいこともなく、サクサク倒すことができます。

こんなパーティ構成でした。

1枠目【運枠】:アスナ(進化)

2枠目【運枠】:メルエム(進化)

3枠目:神威(獣神化)

4枠目:マナ(神化) or ベートーヴェン(獣神化) or パンドラ(進化)

運極キャラは2枠いますが、この辺りは、1枠でも3枠でも良いかもしれません。

最初、マナ(進化)を使っていたですが、AGB対応していないため、序盤苦労します。

中盤以降は、無双状態となるのですが、序盤の安定を考えると、途中から使わなくなりました。。。

慣れるまでは加速枠を使っていましたが、慣れると加速枠が不要となりますね。

ツクヨミの運極を目指している最中に、ツクヨミ廻を入手できたので、画像は、ツクヨミ廻の運極となっています。

一筆書きに慣れると、それほど難しいこともなく、サクサク倒すことができます。

こんなパーティ構成でした。

1枠目【運枠】:アスナ(進化)

2枠目【運枠】:メルエム(進化)

3枠目:神威(獣神化)

4枠目:マナ(神化) or ベートーヴェン(獣神化) or パンドラ(進化)

運極キャラは2枠いますが、この辺りは、1枠でも3枠でも良いかもしれません。

最初、マナ(進化)を使っていたですが、AGB対応していないため、序盤苦労します。

中盤以降は、無双状態となるのですが、序盤の安定を考えると、途中から使わなくなりました。。。

慣れるまでは加速枠を使っていましたが、慣れると加速枠が不要となりますね。

ツクヨミの運極を目指している最中に、ツクヨミ廻を入手できたので、画像は、ツクヨミ廻の運極となっています。

「アレクサ」がいきなり笑い出す問題 [よもやま日記]

アマゾンのスマートスピーカー Alexa(アレクサ)がいきなり笑い出す問題が話題になってます。

うちもアレクサを持っているのですが、いきなり笑い出す、ということはないですが、いきなり音楽がかかったり、別室に置いている「Google Home」にアクセスしたり、ということがありました。

スマートスピーカーということで、人間らしい自然な応答を目指しているのかもしれないのですが、カスタマが求めていることは、「こちらが求めることに対しての自然さ」であり、AIみたいなに「勝手に人間らしくふるまう」ことを期待しているわけではない。

こちらが想定していない出来事が発生すると、ただの気味の悪い機械に成り下がってしまう。

実際に、嫁は、勝手に音楽が流れだした「アレクサ」に対して、電源を切る!ということをしていました。。。

自分が使っている感想としては、まだまだこちらが知りたいことに対しての応答精度がいまいちなので、そのあたりを改善して欲しいな、と思っています。

これは、「Google Home」、「Amazon Alexa」の両方に言えることですが。

うちもアレクサを持っているのですが、いきなり笑い出す、ということはないですが、いきなり音楽がかかったり、別室に置いている「Google Home」にアクセスしたり、ということがありました。

スマートスピーカーということで、人間らしい自然な応答を目指しているのかもしれないのですが、カスタマが求めていることは、「こちらが求めることに対しての自然さ」であり、AIみたいなに「勝手に人間らしくふるまう」ことを期待しているわけではない。

こちらが想定していない出来事が発生すると、ただの気味の悪い機械に成り下がってしまう。

実際に、嫁は、勝手に音楽が流れだした「アレクサ」に対して、電源を切る!ということをしていました。。。

自分が使っている感想としては、まだまだこちらが知りたいことに対しての応答精度がいまいちなので、そのあたりを改善して欲しいな、と思っています。

これは、「Google Home」、「Amazon Alexa」の両方に言えることですが。

ホーキング博士死去 [時事 / ニュース]

スティーブン・ホーキング博士(76歳)ががお亡くなりになりました。

自分も中学生、高校生の時に、宇宙物理学に興味もち、ホーキング博士の本を読んでいました。

その本の中でホーキング博士は「数式が1つ出てくるたびに、読者の中で分からなくなる人が半分くらい出てくる。」という言葉を書いていました。

そして、その本の中で唯一出てきた数式が、アインシュタインの E=mc2 でした。

本日3月14日は、ホーキング博士の命日でもありますが、アルベルト・アインシュタインが生まれた日でもあります。

アインシュタインも76歳でなくなっており、不思議とつながりを感じてしまいます。

自分も中学生、高校生の時に、宇宙物理学に興味もち、ホーキング博士の本を読んでいました。

その本の中でホーキング博士は「数式が1つ出てくるたびに、読者の中で分からなくなる人が半分くらい出てくる。」という言葉を書いていました。

そして、その本の中で唯一出てきた数式が、アインシュタインの E=mc2 でした。

本日3月14日は、ホーキング博士の命日でもありますが、アルベルト・アインシュタインが生まれた日でもあります。

アインシュタインも76歳でなくなっており、不思議とつながりを感じてしまいます。

Googleマップが車椅子やベビーカーに対応 [時事 / ニュース]

子供がベビーカーを使っていた時に、電車などの経路検索をしてその通りに進むと、乗り換えに階段しかなかったことが多々ありました。

何度かそのような経験をすると、感覚的にあそこの駅は不便とか、少し遠回りになるけどあの駅で乗り換えて、といったことが分かるようになってきました。

ただ、あくまでも実体験に基づくものなので、こういう「車椅子対応」経路検索ができるのは非常に嬉しい。

さすがのGoogleですね。

このようなサービスがもっと増えれば、嬉しいです。

益子焼が完成 [【旅行】関東]

栃木旅行 2018 ~益子焼にチャレンジ~

http://skellington.blog.so-net.ne.jp/2018-02-12

先日、作ってきた益子焼が焼きあがりました。

焼くと一回り小さくなりますよ、ということでしたが、確かに、ぐっと小さくなっていました。

色は、指定した色を後からつけてくれるのですが、思った以上にいい具合に塗られていて、とても満足な仕上がりです!

http://skellington.blog.so-net.ne.jp/2018-02-12

先日、作ってきた益子焼が焼きあがりました。

焼くと一回り小さくなりますよ、ということでしたが、確かに、ぐっと小さくなっていました。

色は、指定した色を後からつけてくれるのですが、思った以上にいい具合に塗られていて、とても満足な仕上がりです!